Pentagon tlačí na vývoj autonomních zbraní řízených umělou inteligencí, které mohou zabíjet bez lidského zásahu. Šéf společnosti Anthropic varuje, že tím mizí poslední právní pojistky, které brání páchání válečných zločinů – a riziko může být větší uvnitř systému než zvenčí.

Výhrůžka Peta Hegsetha Dariu Amodeiovi má podtext, který dalece přesahuje kontrakt v hodnotě 200 milionů dolarů (4,11 miliard korun), který může Pentagon zrušit: pokud americká armáda nasadí autonomní zbraně řízené umělou inteligencí bez ochranných opatření, která Anthropic požaduje, odstraní jediný firewall, který v minulosti zabránil provedení nezákonného rozkazu.

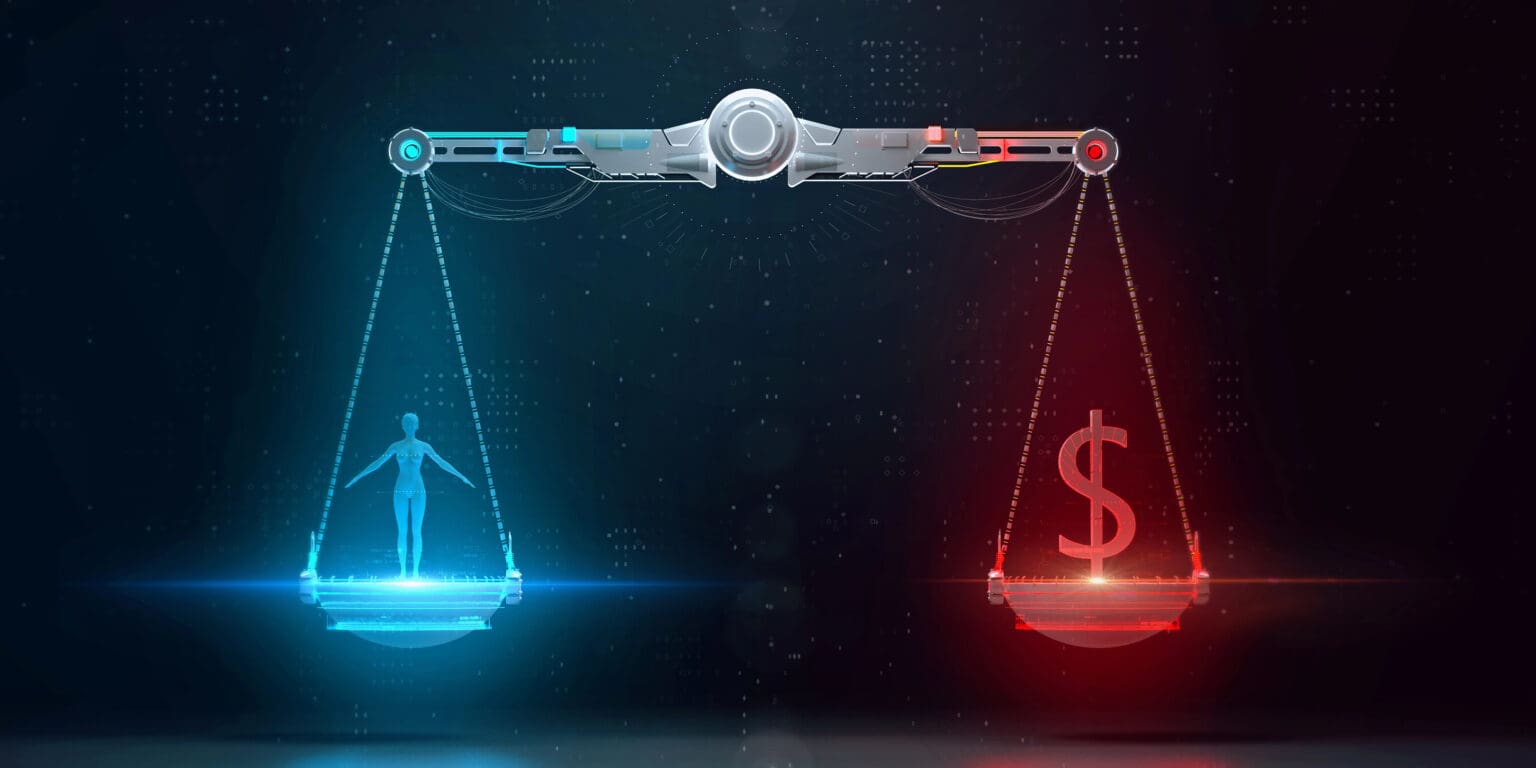

Celý právní a etický systém americké armády stojí na principu, který se zdá být zřejmý, ale má důležité důsledky: voják může a měl by neuposlechnout zjevně nezákonný rozkaz. Je to mechanismus, který teoreticky zabraňuje válečným zločinům. Autonomní dron řízený umělou inteligencí takový mechanismus nemá. Nemůže odmítnout. Nemůže váhat. Nemůže být postaven před válečný soud.

Amodei hovoří o „autonomních zbraních, které střílejí bez lidského zásahu“, aby poukázal na právní mezeru. Pokud umělá inteligence rozhodne o zabití, kdo je trestně odpovědný? Programátor? Generál, který systém aktivoval? Prezident, který podepsal rozkaz? Mezinárodní humanitární právo (včetně Ženevských úmluv) bylo napsáno s ohledem na lidské rozhodující činitele. A nyní umělá inteligence tento řetězec odpovědnosti ruší.

Hegseth gives Anthropic until Friday to back down on AI safeguards, Axios reports https://t.co/nghhqECNA4 https://t.co/nghhqECNA4

— Reuters (@Reuters) February 24, 2026

Argument o masovém sledování je také hořkou pilulkou, kterou je třeba spolknout. Čtvrtý dodatek americké ústavy chrání občany před neoprávněnými prohlídkami a odposlechy. Funguje mimo jiné proto, že stát nikdy neměl fyzickou kapacitu zpracovávat vše, co se děje ve veřejném prostoru.

A podobně s umělou inteligencí tento operační limit mizí: přecházíme na miliony rozhovorů zaznamenaných v reálném čase, přepsaných, utajených a propojených během pouhých sekund. To, co bylo dříve nemožné kvůli nedostatku lidských zdrojů, se s LLM stává rutinou. Ústavní ochrana dosud částečně závisela na neefektivitě státu, na jeho omezenosti. Pentagon má argument, který nelze odmítnout: tyto schopnosti vyvíjejí i jiné demokratické země a Čína nebo Rusko nebudou čekat, až USA vyřeší svá etická dilemata.

Praktickou otázkou je, zda vlastnictví takových neomezených schopností zvyšuje bezpečnost, nebo je prostě nebezpečnější pro vlastní občany. Amodei na tuto otázku již několik měsíců odpovídá konkrétní představou: „Hrstka lidí schopná obsluhovat armádu bezpilotních letounů, aniž by ke spolupráci potřebovala další lidské bytosti.“ Jinými slovy, riziko není jen vnější.

OpenAI a Google souhlasily s podmínkami Pentagonu, tedy „veškerým zákonným použitím“ bez konkrétních výjimek, a xAI právě získala povolení pracovat v utajovaných systémech. Anthropic zůstal ve své pozici osamocen.

A v sázce nyní není to, zda Claude jako vojenský dodavatel přežije, nebo ne, ale to, zda průmysl umělé inteligence stanoví nějaké limity pro to, co prodává státu, nebo zda tuto debatu vyřeší přímo Kongres, soudy nebo v nejhorším případě první vážný incident, který nikdo nedokázal předvídat. Zdá se, že je to otázka času.

Toto dilema není ve Spojených státech ojedinělé. S regulací autonomních zbraní se potýká i mezinárodní společenství. Úmluva OSN o některých konvenčních zbraních je fórem pro diskusi o důsledcích autonomních zbraní, ale zatím nebylo dosaženo shody na tom, jak je účinně regulovat. Některé země prosazují úplný zákaz, zatímco jiné dávají přednost flexibilnějšímu přístupu, který umožňuje řízený vývoj těchto technologií.

Kromě právních otázek vyvolávají autonomní zbraně vážné etické problémy. Představa, že stroj může rozhodovat o životě a smrti bez zásahu člověka, zpochybňuje základní principy vojenské etiky a lidských práv. Schopnost umělé inteligence pracovat bez lidských emocí a empatie by mohla vést k odlidštěným rozhodnutím na bojišti.

S technologickým pokrokem budeme pravděpodobně svědky nárůstu využívání umělé inteligence ve vojenských aplikacích. Je však nezbytné, aby tyto technologie byly vyvíjeny a nasazovány zodpovědně. Mezinárodní spolupráce a vytvoření jasných právních rámců budou mít zásadní význam pro zajištění toho, aby se autonomní zbraně používaly způsobem, který respektuje lidská práva a mezinárodní právo.