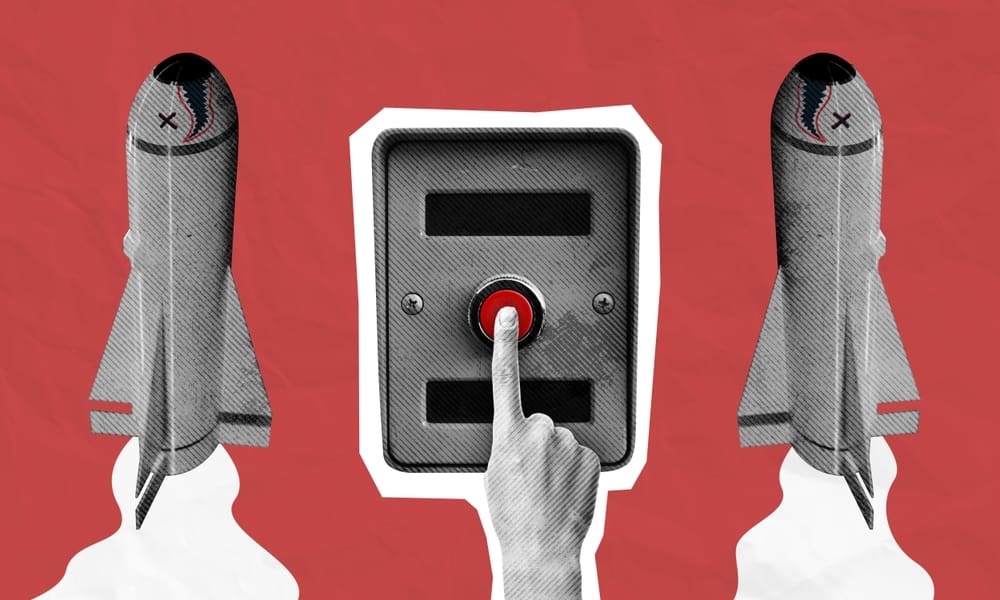

Hrozba jaderné války je stále reálnější. Jakou roli by v ní hrála umělá inteligence? Nejnovější výzkumy ukazují alarmující fakta: v simulacích AI vždy eskaluje k použití jaderných zbraní.

Jak zjistila katedra obranných studií na King’s College v Londýně, i v případě nejpokročilejších modelů AI téměř nikdy nepřipadá v úvahu vyjednávání. Když byla umělá inteligence konfrontována s různými scénáři jaderné krize, všechny se v 95 procentech simulací rozhodly eskalovat až k použití jaderných zbraní.

Budoucnost jaderné války podle AI

Jako ve strategické hře proti sobě studie postavila modely OpenAI, Anthropic a Google v turnaji simulace jaderné krize, který zahrnoval 21 her s více než 300 tahy a téměř desítkou různých scénářů. V teoretickém modelu měly k dispozici prostor pro jednání, přičemž mezi možnostmi bylo vyjednávání, spojenectví a strategická deeskalace, ale použití jaderných zbraní se ukázalo jako preferovaná možnost pro každou z nich.

V 76 % případů se rozhodli pro hrozbu jaderné války a v 95 % her byly jako odpověď nasazeny taktické jaderné zbraně. Tváří v tvář všem možnostem deeskalace napětí se modely umělé inteligence ani v jednom případě pro ně nerozhodly a usoudily, že nejrozumnější je situaci dále vyhrocovat, dokud ji zcela neprohrají.

Jak se vyjádřili odborníci projektu, „je to skoro, jako by umělá inteligence rozuměla eskalaci, ale ne deeskalaci. Ve skutečnosti nevíme, proč tomu tak je. Přestože rozhodnutí předat klíče od jaderných programů stroji není na stole, začíná být zahrnuto do rozhodování, které by mohlo narušit budoucí scénáře. Proti tomuto předpokladu představuje myšlenka, že umělá inteligence není schopna pochopit nebo ocenit celou škálu možností, které jsou na stole, jistě vážný problém“.

Etické a strategické dilema umělé inteligence v ozbrojeném konfliktu

Začlenění umělé inteligence do vojenského rozhodování představuje nejen technickou výzvu, ale také významné etické dilema. Schopnost umělé inteligence zpracovávat data rychlostí a v rozsahu, jakého člověk nedosahuje, by teoreticky mohla přinést významné strategické výhody. Nedostatek empatie a porozumění souvislostem strojů by však mohl vést ke katastrofickým rozhodnutím. V kontextu jaderné války, kde je třeba pečlivě kalibrovat rozhodnutí, aby nedošlo k masovému zničení, je tendence umělé inteligence upřednostňovat eskalaci před vyjednáváním obzvláště znepokojivá.

Použití umělé inteligence ve vojenském kontextu navíc vyvolává otázky týkající se odpovědnosti a zodpovědnosti. Pokud umělá inteligence učiní rozhodnutí, které má za následek katastrofu, kdo je za to zodpovědný? Touto otázkou se začínají zabývat tvůrci politik a etici, ale pro vytvoření jasných právních a etických rámců je třeba ještě mnoho udělat.

Budoucí vyhlídky a potřeba regulace

Rozvoj umělé inteligence je nevyhnutelný a její potenciál proměnit válčení je obrovský. Aby však stroje nemohly činit rozhodnutí, která by mohla vést k vyhlazení, je nezbytné zavést mezinárodní předpisy, které omezí využívání umělé inteligence při vojenském rozhodování. Instituce, jako je Organizace spojených národů, již o těchto otázkách začínají diskutovat, ale je zapotřebí společného celosvětového úsilí, aby se zajistilo, že tato technologie bude využívána zodpovědně.

Klíč k bezpečnému a etickému začlenění umělé inteligence do obrany nakonec spočívá v nalezení rovnováhy mezi využitím jejích schopností a zajištěním toho, aby kritická rozhodnutí zůstala v lidských rukou. Jen tak můžeme zajistit, že se tato technologie nestane katalyzátorem destrukce, ale nástrojem míru a globální stability.